Featherless

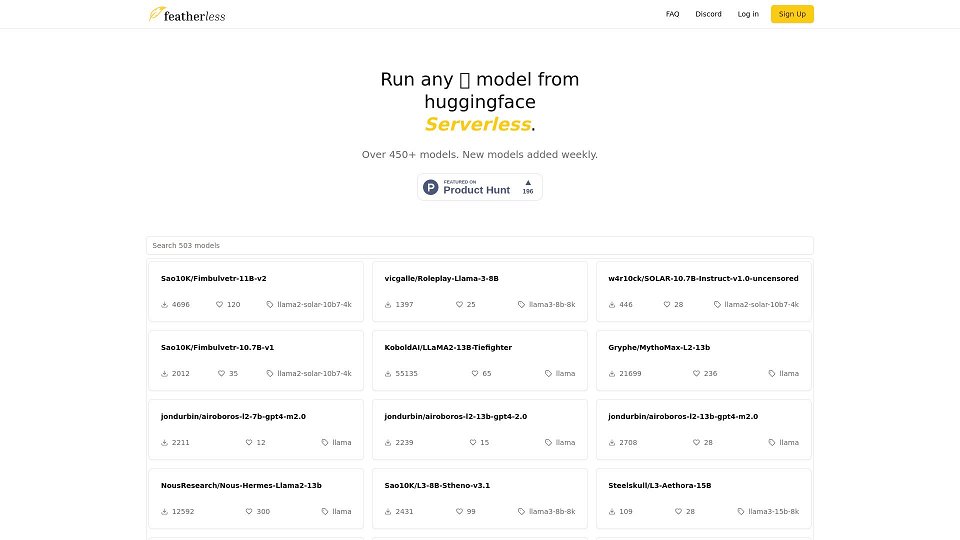

Featherless - サーバーレスLLM

Featherless - 最新のLLMモデル、サーバーレスでリクエストに応じて使用できます。

Featherlessの紹介

Featherlessは、Hugging Faceでホストされているさまざまな大規模言語モデル(LLM)へのサブスクリプションベースのアクセスを提供するAIモデルプロバイダです。ユーザーはOpenAI互換のAPIを介してこれらのモデルと対話できるサーバーレスプラットフォームを提供しています。Featherlessは、LLaMA-3やQWEN-2を含む強力なLLMへの費用効果の高いアクセスを重視し、FP8量子化による高速な推論速度を実現しています。ユーザーのインタラクションをログに記録しないことで、プライバシーを重視しています。Featherlessは、マルチリンガルで手頃な価格のモデルのトレーニングとスケーリングに収益の一部を貢献して、オープンソースのAI開発をサポートしています。

Featherlessの使用例

さまざまなLLMへのアクセスと実験

OpenAI互換のAPIを使用したAIパワードアプリケーションの開発

高価なハードウェアを必要とせずに個人プロジェクトでAIモデルを実行する

テキスト生成、チャットボット、コード生成などのタスクにLLMを利用する

Featherlessの主要機能

無制限の個人利用*

毎週更新されるコミュニティモデルのリスト

完全なOpenAI互換のAPIアクセス

15Bモデル(ベーシック)/ 72Bモデル(プレミアム)までのアクセス

ログなしのプライベートで安全な匿名利用

Featherlessのよくある質問

Featherlessとは何ですか?

Featherlessは、私たちのサブスクライバーにHugging Faceモデルの絶えず拡大するライブラリへのアクセスを提供するAIモデルプロバイダです。 Featherless: 手間が少なく、努力が少ない。今すぐ始めましょう。

いくらですか?

月額10ドルと25ドルの2つの価格プランを提供しています。 もし同時接続の制限が本当の個人利用に制約がある場合は、<a>discord</a>を通じてお問い合わせください。

ログは保存されますか?

いいえ。プライバシーを重視したサービスとして、チャット、プロンプト、補完のいずれもログに記録しません。

どのモデルアーキテクチャがサポートされていますか?

現在、LLaMA-3ベースのモデル、LLaMA-3およびQWEN-2をサポートしています。 ただし、QWEN-2モデルは16,000コンテキスト長までしかサポートされていません。 今後、サポートリストに他のアーキテクチャを追加する予定です。

新しいモデルを追加するにはどうすればいいですか?

私たちの<a>discord</a>で連絡してください。 Hugging Faceで利用可能になると、新しいモデルを継続的に追加しています。 成長に伴い、互換性のあるアーキテクチャを持つすべての公開可能なHugging Faceモデルを自動的にカバーするようにすることを目指しています。

無制限とはどれくらいの範囲ですか?

購読を継続している限り、モデルの使用に時間制限はありません。 個々のアカウントの公正な使用を確保するために、同時リクエストは選択したプランに応じて制限されます。 出力は、モデルとプロンプトのサイズに応じて、1秒あたり10〜40トークンの速度で提供されます。

連絡する方法はありますか?

私たちの<a>discord</a>に参加するか、<a>r/SillyTavernAI</a>で私たちに会いに来てください。

量子化モデルを実行していますか?

はい、FP8量子化を使用しています。 コミュニティとの協議の結果、このアプローチは出力品質を維持しながら推論速度を大幅に向上させることがわかりました。

どのようにして多くのモデルを実行できるのですか?

プラットフォームの中心には、カスタム推論スタックがあります。そこでは、互換性のあるアーキテクチャを持つすべての公開可能なHugging Faceモデルを動的に実行できます。

Featherlessを使用するユーザー

AI開発者

研究者

趣味の人

手頃な価格でアクセス可能なLLMソリューションを探している個人や企業