Featherless

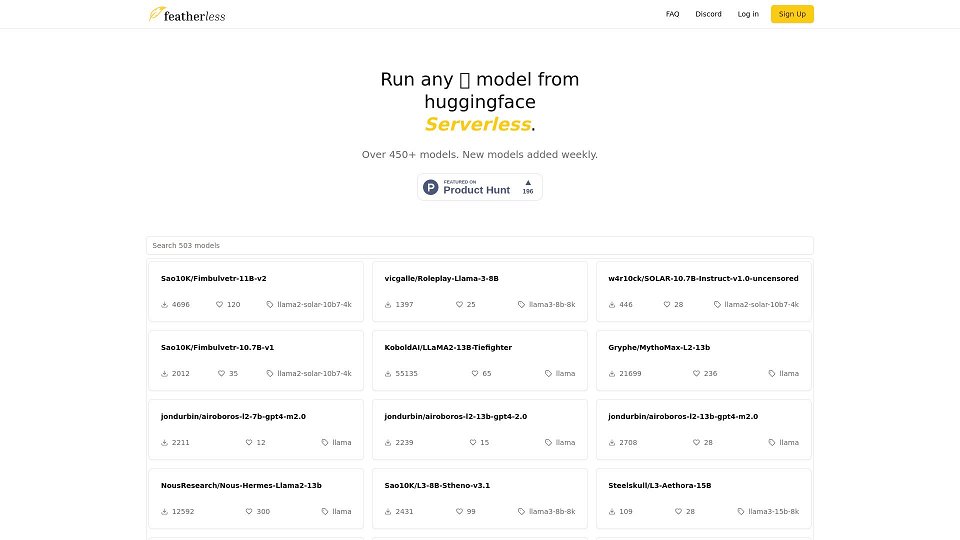

Featherless - Serverless LLM

Featherless - De nieuwste LLM-modellen, serverless en klaar voor gebruik op uw verzoek.

Featherless Introductie

Featherless is een AI-modelprovider die abonnementstoegang biedt tot een breed scala aan grote taalmodellen (LLM's) gehost op Hugging Face. Het biedt een serverloos platform waar gebruikers kunnen communiceren met deze modellen via een OpenAI-compatibele API. Featherless richt zich op het bieden van kosteneffectieve toegang tot krachtige LLM's, waaronder LLaMA-3 en QWEN-2, met hoge inferentiesnelheden dankzij FP8-kwantisering. Ze geven prioriteit aan de privacy van gebruikers door geen gebruikersinteracties te registreren. Featherless ondersteunt en draagt ook bij aan open-source AI-ontwikkeling, waarbij een deel van de omzet wordt besteed aan het trainen en schalen van meertalige en betaalbare modellen.

Featherless Gebruikssituaties

Toegang tot en experimenteren met verschillende LLM's

Het ontwikkelen van AI-gestuurde applicaties met behulp van een OpenAI-compatibele API

Het uitvoeren van AI-modellen voor persoonlijke projecten zonder de noodzaak van dure hardware

Het gebruik van LLM's voor taken zoals tekstgeneratie, chatbots en codegeneratie

Kernfuncties van Featherless

Onbeperkt persoonlijk gebruik*

Steeds groeiende lijst van community-modellen, wekelijks bijgewerkt

Volledige toegang tot OpenAI-compatibele API

Toegang tot maximaal 15B-modellen (Basis) / 72B-modellen (Premium)

Privé, veilig en anoniem gebruik - geen logs

Featherless Veelgestelde Vragen

Wat is Featherless?

Featherless is een AI-modelprovider die onze abonnees toegang biedt tot een voortdurend groeiende bibliotheek van Hugging Face-modellen. Featherless: Minder gedoe, minder moeite. Begin nu.

Wat kost het?

We bieden twee prijsplannen aan voor $10 en $25 per maand. Als de gelijktijdigheidslimieten te beperkend zijn voor echt persoonlijk gebruik, neem dan contact met ons op via onze <a>discord</a>.

Worden mijn logs opgeslagen?

Nee. Als een op privacy gerichte service, registreren we geen van uw chats, prompts of voltooide acties.

Welk modelarchitectuur wordt ondersteund?

Op dit moment ondersteunen we op LLaMA-3 gebaseerde modellen, waaronder LLaMA-3 en QWEN-2. Merk op dat QWEN-2-modellen alleen worden ondersteund tot een contextlengte van 16.000. We zijn van plan om binnenkort meer architecturen aan onze ondersteunde lijst toe te voegen.

Hoe voeg ik nieuwe modellen toe?

Neem contact met ons op via onze <a>discord</a>. We voegen continu nieuwe modellen toe zodra ze beschikbaar komen op Hugging Face. Naarmate we groeien, streven we ernaar dit proces te automatiseren om <em>alle</em> openbaar beschikbare Hugging Face-modellen met compatibele architectuur op te nemen.

Hoe onbeperkt is 'onbeperkt'?

Zolang u geabonneerd blijft, is er geen tijdslimiet voor het gebruik van modellen. Om eerlijk individueel accountgebruik te waarborgen, zijn gelijktijdige verzoeken beperkt volgens het door u geselecteerde plan. Output wordt geleverd met een snelheid van 10-40 tokens per seconde, afhankelijk van het model en de grootte van de prompt.

Hoe kan ik contact opnemen?

Sluit u aan bij onze <a>discord</a> of zoek ons op op <a>r/SillyTavernAI</a>

Gebruikt u gekwantiseerde modellen?

Ja, we gebruiken FP8-kwantisering. Na overleg met de community hebben we ontdekt dat deze aanpak de outputkwaliteit behoudt terwijl de inferentiesnelheden aanzienlijk worden verbeterd.

Hoe kunt u zoveel modellen uitvoeren?

In het hart van het platform bevindt zich onze aangepaste inferentiestack, waarin we dynamisch kunnen schalen en modellen kunnen uitvoeren op basis van de vraag en de capaciteit van ons systeem.

Gebruikers die Featherless gebruiken

AI-ontwikkelaars

Onderzoekers

Hobbyisten

Individuen en bedrijven die op zoek zijn naar betaalbare en toegankelijke LLM-oplossingen